ngrinder를 활용한 scale 조정에 따른 web server 부하 테스트

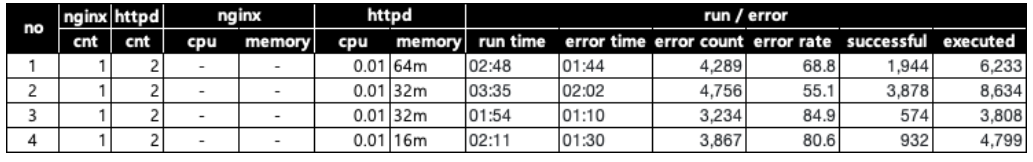

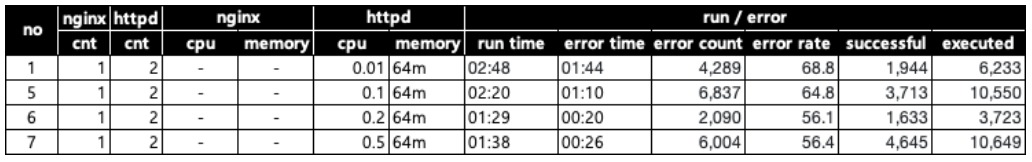

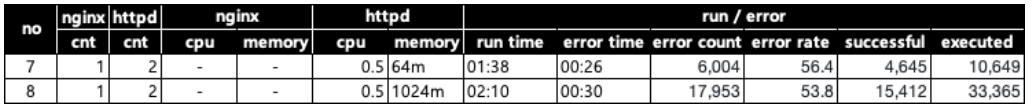

✔️ Nginx와 Apache HTTPD를 활용하여 Web Server에 load balancing 구현

✔️ Ngrinder를 활용하여 Web Server에 대한 Scale up&down 또는 in&out을 통해 부하 테스트를 진행하며 최적 환경 탐색

ngrinder를 활용한 scale 조정에 따른 web server 부하 테스트

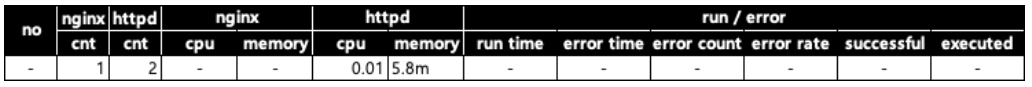

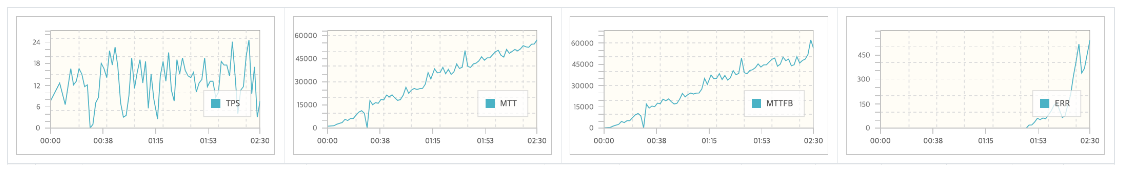

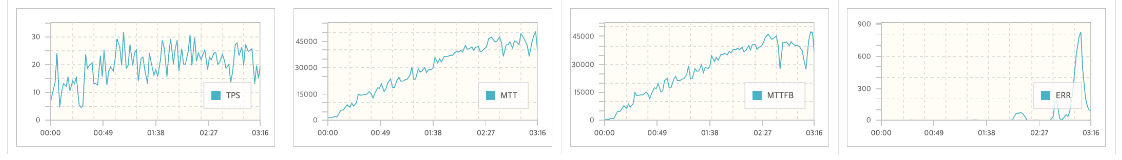

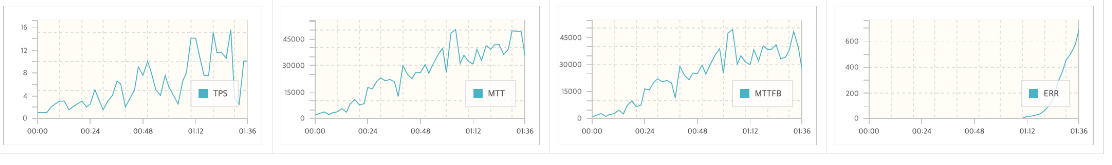

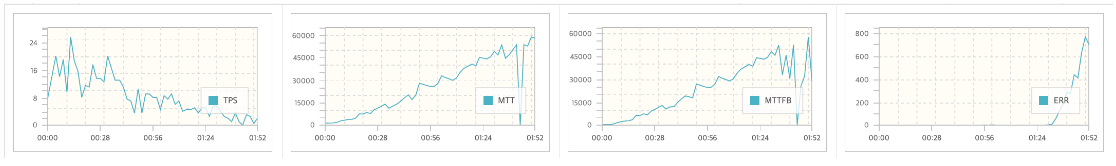

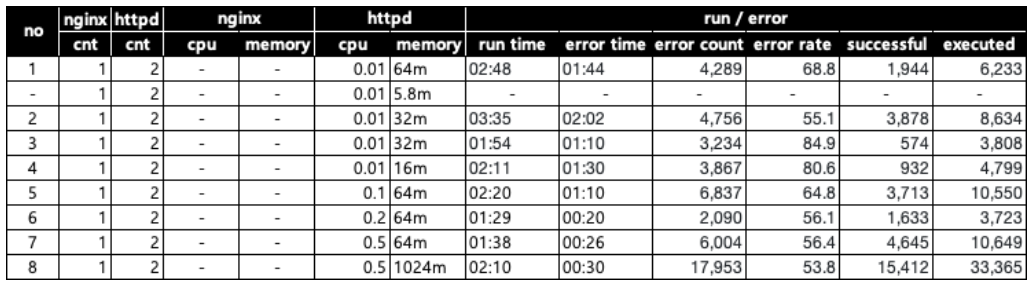

- executed : 실행된 전체 테스트의 수

- succesful : executed 중 성공한 테스트의 수

- error count : executed 중 에러난 테스트의 수

- error rate : executed 중 에러난 테스트의 비율

- error time : 첫 에러가 발생한 시간 (첫 에러 발생 이후 점차 에러가 증가하는 추세이므로 첫 발생 지점을 기록)